百度Create大会:百度AI安全研究的进展与愿景

2022.01.12 16:05浏览量:708简介:百度首席安全科学家李康向大家分享了百度AI安全研究的进展与愿景。

以“有AI,更安全”为理念,百度安全在AI安全领域的探索始终处于行业前沿,率先提出了Security、Safety和Privacy三大AI安全研究维度,分别指向了强对抗安全、非对抗安全、及数据安全与隐私保护。为行业提供了一个面向AI安全的研究思路与实践方向。而在过去的一年里,百度安全也在模型安全、数据安全及AIoT等多个方面取得了长足的进展,这一系列AI安全能力成为百度AI体系构建中不可或缺的关键一环。在众所瞩目的2021百度Create大会AI安全分论坛上,由百度首席安全科学家李康向大家分享了百度AI安全研究的进展与愿景。

虽然AI技术领域火热的研究趋势和高效的开发迭代速度可以应对日益剧增的需求,但技术的频繁更新和开发的高速迭代仍对底层的计算框架的安全性带来了冲击。一方面,针对 AI 系统的恶意攻击愈发频繁,如通过在输入样本中填入细微的、通常无法识别的干扰,导致模型给出标识欺骗、位置偏离等错误输出的对抗样本攻击。对此,百度安全在今年九月发布的PaddleSleeve,融合了Advbox对抗样本攻击及Robustness鲁棒性评估等诸多能力。同时,聚焦于隐私性,PaddleSleeve能够支持AUC、Recall、结构相似度、峰值信噪比(Peak SNR)等隐私攻击效果评估指标,可实现对模型数据被还原风险及模型是否存在关键信息泄露风险的检测,赋能企业和开发者可通过新训练、模型精调等方式进行对抗训练,并可借助多种过滤算法在不修改模型的情况下实现非侵入式的对抗鲁棒性增强。目前,PaddleSleeve已在多个场景中实现对飞桨自定义及预训练模型,ResNet、YOLO等通用产业级模型的支持。

另一方面,AI技术已经被广泛应用于各行各业,如何确保AI计算框架的代码开发质量也成为了代码开发过程中必不可少的一部分。而在今年的Black Hat Europe上,百度安全提出了一种新型的基于模型变异的模糊测试工具AI Model-Mutator。它将模型文件作为数据输入文件,进行变异来测试底层计算框架的代码质量。和功能测试不同的是,它采用的是针对模型的随机变异,所以可以覆盖很多功能测试不能考虑到的边界问题。更详细来说,它利用静态代码分析获取模型相关操作的类型和约束条件,然后根据这些操作类型和约束条件进行随机的图遍历和改写。最后,利用生成的变异后的模型文件作为种子对计算框架进行测试。除此以外,AI Model-Mutator提出了一系列针对模型输入的变异规则来进行有效地模型文件变异,在今年百度安全已发布100+多个安全问题并已获得80+ 相关CVEs,其中多个AI框架的新型漏洞得到TensorFlow团队的确认。

在AI Privacy的隐私保护方向上,尤其是在保护AI训练和推理时,即便是使用了硬件防御机制,软件栈上的设计不当,尤其是与硬件编程模型的差异性,会导致敏感信息泄露。百度是世界上最流行的机密计算开源框架Teaclave的主导者,帮助用户基于硬件安全能力,确保敏感数据在可信域外和离岸场景下安全可控的流通和处理。除基于SGX技术外,还推出了Teaclave Trustzone SDK。通过在GlobalPlatform标准的API上重新设计了安全的Rust接口,使用Rust编写 TA(Trusted Apps)和App(Client Apps),大大减少内存安全问题,确保可信执行环境的安全。使得在敏感数据处理的端、边、云各环节均可引入机密计算技术,实现端、边、云一体化的端到端安全可信,让敏感数据在传输、存储和使用中的每个环节均处于加密状态,只有授权程序才能处理敏感数据,且处理过程可以通过Remote Attestation进行技术验证。

在国内外监管环境日渐完善的今天,大家都在加强数据保护意识,而AI能力同样可用于安全问题、隐私问题检测及动态分析,百度安全所提供的史宾格安全及隐私合规平台,便以先进的人工智能技术为支撑,覆盖产品全生命周期的隐私合规需求,包含隐私数据采集、权限使用场景、 隐私政策管理等多重纬度技术检测能力,得出全面精准地合规风险检测结果。

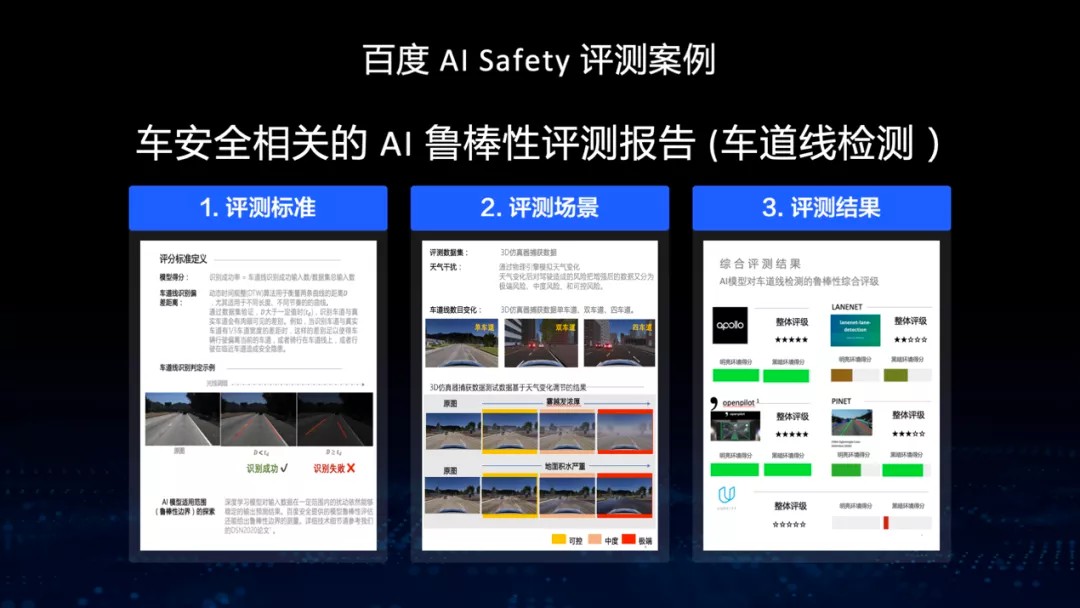

而在AI Safety方向,百度公司一直长期投入自动驾驶技术研究。但百度安全也清楚的知道每个 AI 模型都有实际应用场景的范围,而一旦超出范围模型将无法确保其安全性。百度安全将多种系统安全技术应用到自动驾驶系统中,确保AI系统在各种场景下的安全与稳定,并将模糊测试(Fuzzing)技术与模式检查(Model Checking)技术植入自动驾驶软件测试中,来搭建百度自动驾驶安全测试平台,去结合3D仿真和车辆自动驾驶系统做场景变异,利用车辆轨迹作为测试覆盖率信息,将模糊测试技术创新应用到自动驾驶中。而在形式化验证方面,百度利用模式检查来验证系统是否在运行时执行安全驾驶,遵守交规,行为是否符合预期。以此,形成了百度SimLane数据集与自动驾驶交通灯场景测试数据集,以及车安全相关的 AI 鲁棒性评测报告。并创办首个以自动驾驶安全为主题的CTF比赛活动在2021 DEFCON上,活动吸引全球上百支队伍参加,形成了测试 AI感知和自动驾驶安全的社区。

将来,百度安全会持续关注AI安全,从Safety,Security,Privacy三个方面做好防御工作。防御手段将会是系统安全技术与应用层防御结合,全方位保护AI系统的安全。而伴随一系列新功能的不断加入,百度安全也希望与学术界、产业界持续展开合作,以场景为驱动,面向产业实践,为AI模型安全与隐私保护提供更好的能力支撑。

发表评论

登录后可评论,请前往 登录 或 注册