百度百舸 X SGLang 社区 | 开源生产级 MTP 代码,助力 DeepSeek-V3.2 推理服务 2 倍以上吞吐提升

2025.10.28 14:33浏览量:183简介:开源生产级 MTP 代码,百舸助力 DeepSeek-V3.2 推理服务 2 倍以上吞吐提升

开源社区是 AI 创新的核心引擎。通过全球开发者的智慧碰撞与代码共享,我们才能快速突破技术壁垒,共同迈向 AGI 的未来。

近日,百度百舸与 SGLang 社区深度合作,将一套经过生产系统严苛验证的 MTP 高性能推理代码正式开源。

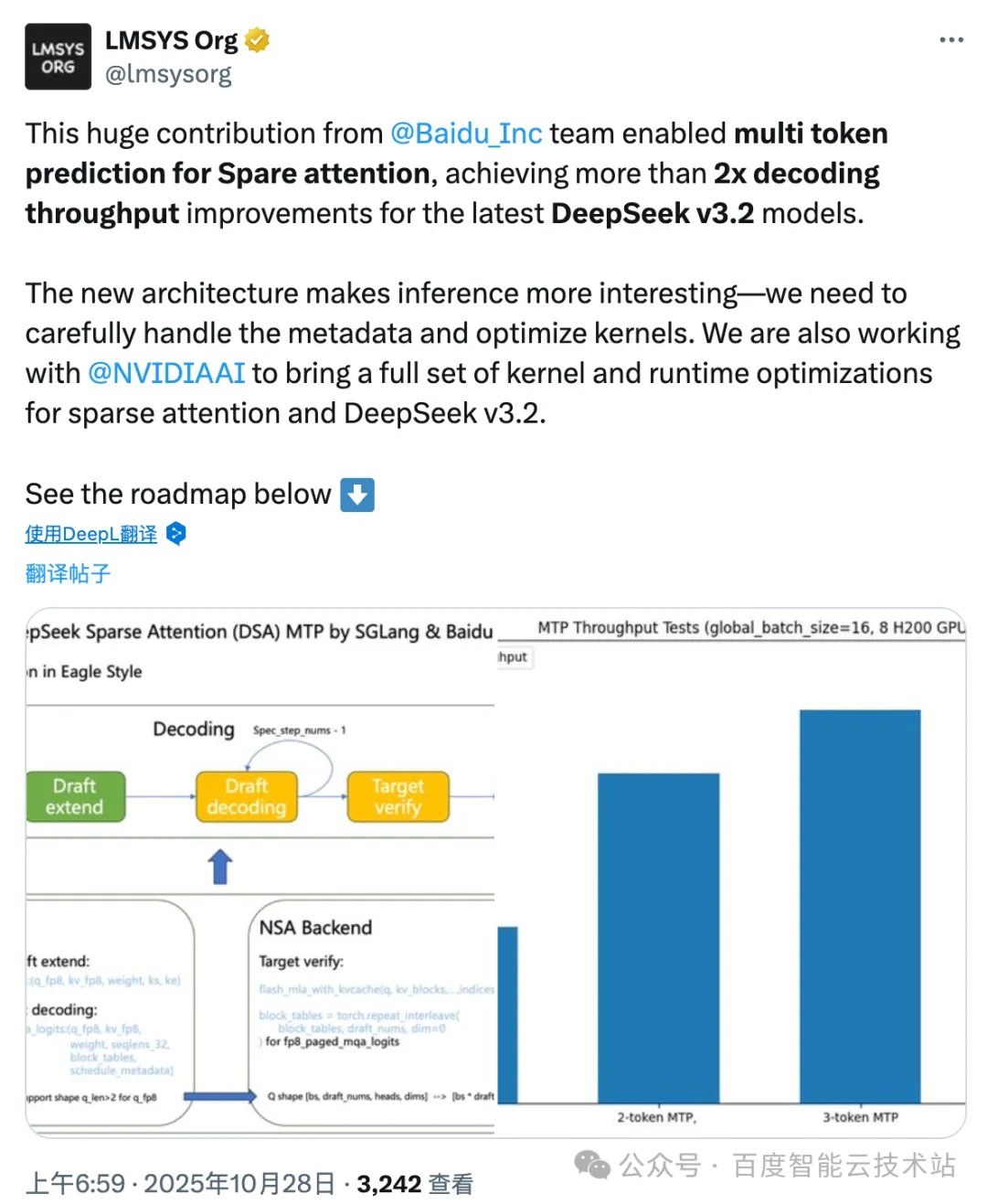

这套代码不仅性能卓越,更在百度内部大规模服务中证明了出色的稳定性与可靠性。SGLang 社区实测表明,该代码为最新的 DeepSeek-V3.2 模型带来了超过 2 倍解码吞吐量的显著性能提升,让社区能够直接部署生产级别的优化方案。

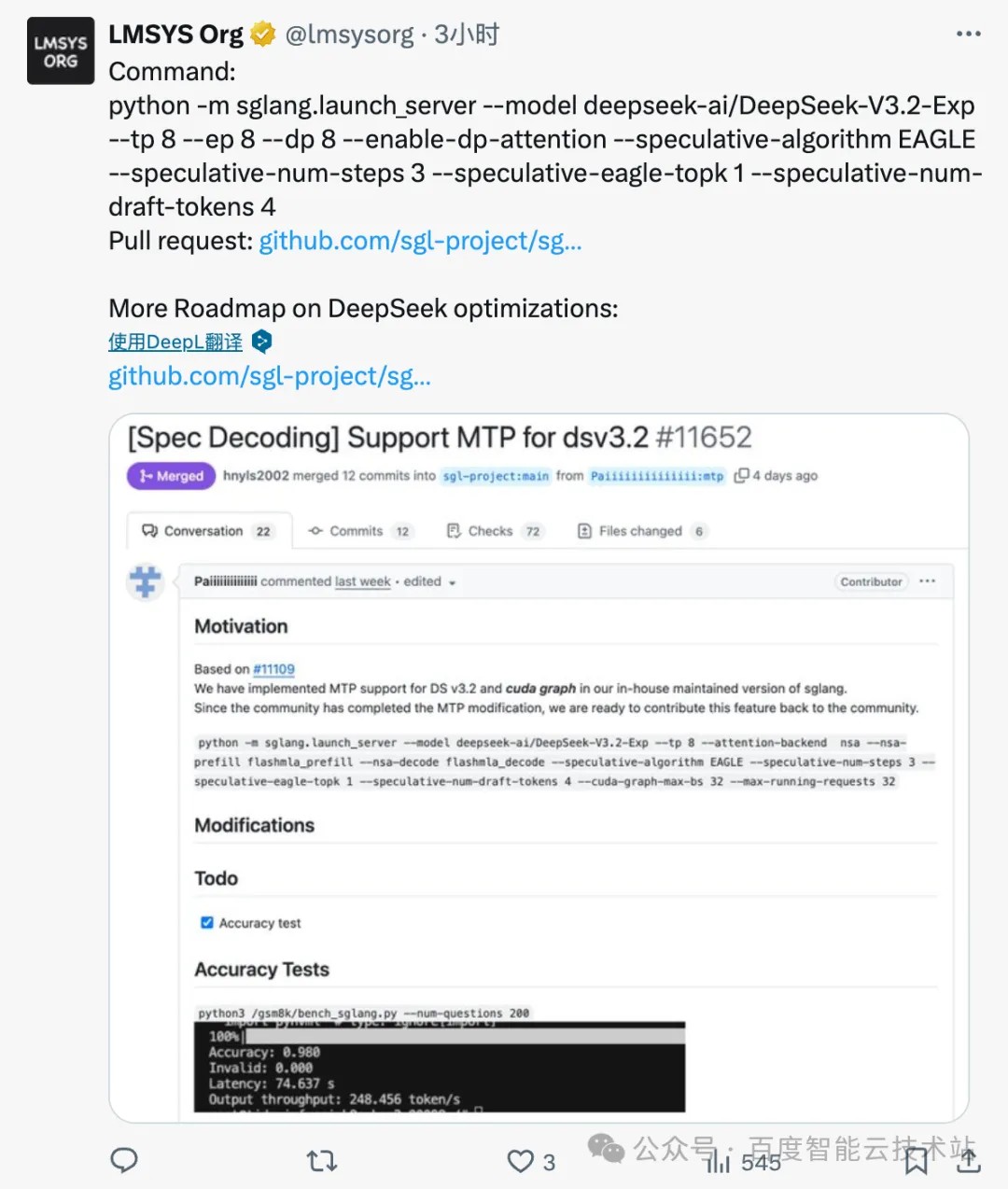

代码地址:https://github.com/sgl-project/sglang/pull/11652

本次开源的核心,是一个为 DeepSeek-V3.2 全新 DSA 架构量身定制的 MTP 实现。DSA 架构的采用,使得适用于 DeepSeek 老版本的 MTP 代码无法复用于 DeepSeek-V3.2。同时,这一架构升级为推理优化带来了新的挑战,同时也创造了性能突破的新机遇。

MTP 通过让模型在单个前向传播中一次性预测多个未来 token,然后统一验证的方式,显著减少了生成完整序列所需的总步骤数。其核心价值在于通过改变传统解码模式来突破效率瓶颈:

传统方式(自回归解码):模型每次只生成一个 token,生成下一个时必须等待上一个完成。如同逐字输入,过程稳定但速度存在瓶颈。

MTP 方式(批量生成,集中验证):模型会一次性智能地推算出多个后续 token 作为候选,然后统一进行验证。这好比从逐字输入升级为智能联想输入,一次性能提供多个候选词句,从而大幅减少生成轮次,突破序列化瓶颈。

百度智能云的核心工作,正是为全新的 DSA 架构实现了这套高效的 MTP 方案。这一生产级的代码贡献,使得 SGLang 社区开发者无需重复底层探索与试错,能够直接获得性能倍增且稳定可靠的推理能力。

未来,百度百舸 AI 计算平台的研发团队,将持续向 SGLang 社区开源更多生产级别的核心代码,与全球开发者携手,加速大模型技术的创新与普惠。

发表评论

登录后可评论,请前往 登录 或 注册