PyTorch GRU与RNN中的NaN值问题:原因、影响与解决方案

2023.12.25 07:06浏览量:13简介:PyTorch GRU 输出为 NaN 值与 PyTorch RNN 输入

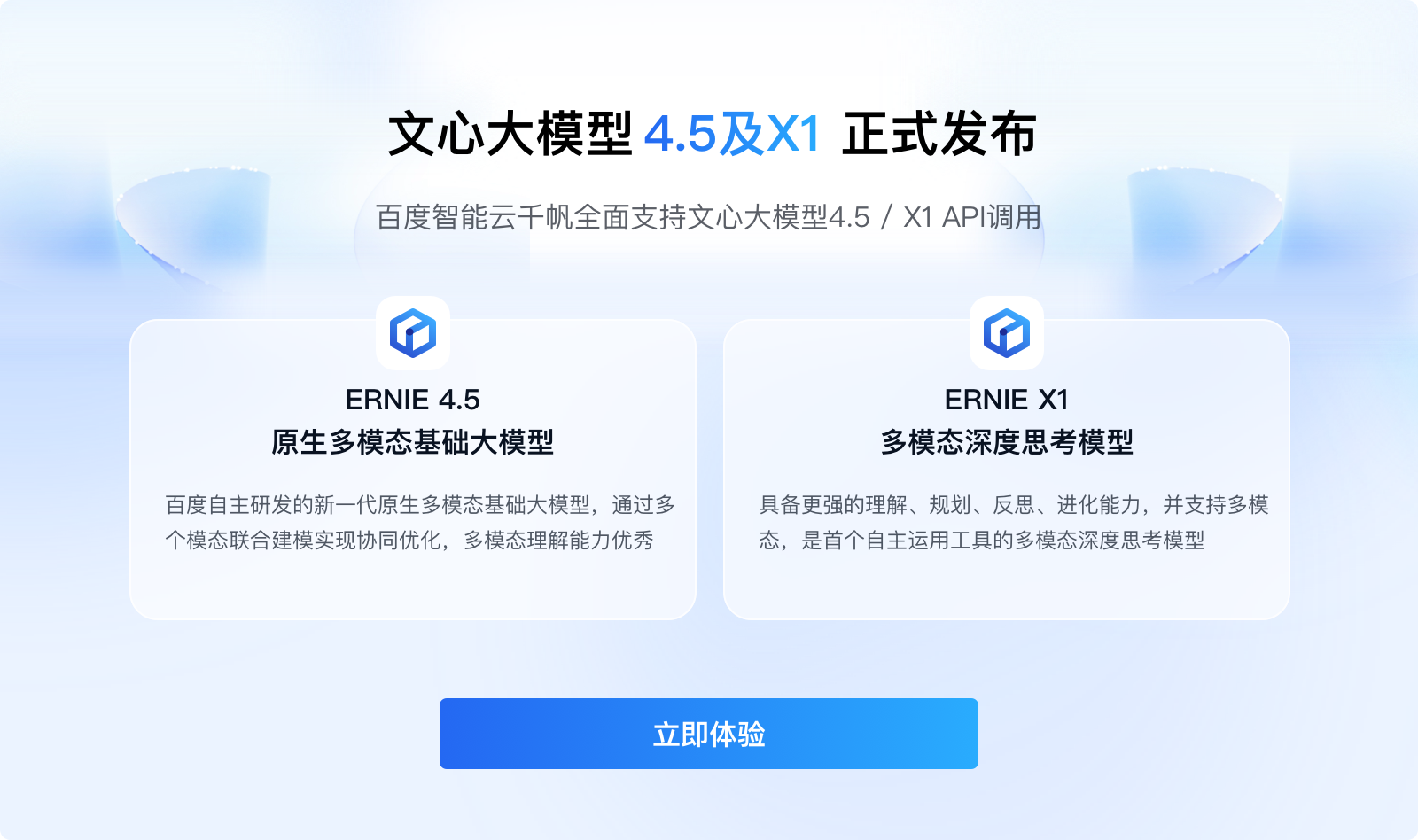

文心大模型4.5及X1 正式发布

百度智能云千帆全面支持文心大模型4.5/X1 API调用

PyTorch GRU 输出为 NaN 值与 PyTorch RNN 输入

在深度学习和自然语言处理领域,循环神经网络(RNN)和其变种,如门控循环单元(GRU)和长短期记忆(LSTM),是处理序列数据的强大工具。然而,在使用这些模型时,有时可能会遇到输出为 NaN(Not a Number)值的问题。尤其是在 PyTorch 的上下文中,这种问题可能会在 GRU 的输出中发生,而这种 NaN 值最终可能作为输入传递给 PyTorch RNN。

NaN 值在数学上是一个特殊的浮点值,用于表示某些无法定义或不可表示的值。在神经网络中,NaN 值通常表示计算过程中出现了不正常的数值,如无穷大或极小值。这些情况可能是由于梯度爆炸、未归一化的权重、错误的激活函数实现等原因造成的。

首先,我们需要理解为什么 GRU 的输出可能会出现 NaN 值。GRU 是 RNN 的一个变种,它通过引入门控机制来控制信息的流动。如果 GRU 中的参数设置不当,或者在训练过程中出现了问题,可能会导致梯度爆炸或消失问题,进而产生 NaN 值。

一旦 GRU 的输出中出现了 NaN 值,这些值可能会作为 RNN 的输入。由于 RNN 的特性,它会将之前时间步的信息存储在状态中,如果这些信息包含 NaN 值,RNN 的行为可能会变得不可预测。这可能会导致训练过程中的错误,甚至导致模型无法收敛。

解决这个问题的方法有很多种。首先,我们需要检查模型的参数和梯度,确保它们在合理的范围内。这可以通过使用梯度裁剪、学习率衰减等技巧来实现。其次,我们还需要确保我们的数据预处理流程正确无误,特别是当我们处理自然语言数据时,预处理阶段中的分词、文本向量化等步骤都需要特别注意。此外,还可以使用激活函数的适当版本,如使用 tanh 代替 sigmoid,以避免在计算过程中出现除以零的情况。

在调试过程中,我们可以使用 PyTorch 的 torch.isnan() 函数来检测包含 NaN 值的张量。一旦检测到 NaN 值,我们可以采取适当的措施来处理它们,例如使用 torch.clamp() 函数将值限制在可接受的范围内。

总的来说,NaN 值在 PyTorch GRU 和 RNN 中的出现可能是由于多种原因引起的。理解这些原因并采取适当的措施来解决它们是保证模型训练质量和稳定性的关键。在未来的研究和实践中,需要更深入地理解 NaN 值在神经网络中的产生机制,以及如何有效和安全地处理这些值。同时,对深度学习库(如 PyTorch)中与 NaN 值处理相关的特性和技巧的理解和应用也将对模型的训练和维护产生积极影响。

发表评论

登录后可评论,请前往 登录 或 注册