DeepSeek为何被称作“国运级”突破?技术、战略与产业影响深度解析

2025.04.01 02:05浏览量:4简介:本文从核心技术突破、产业链重构、国家战略安全三个维度,系统分析DeepSeek大模型的“国运级”意义。通过对比国际主流模型的技术指标,结合具体产业应用案例,揭示其在AI基础设施自主可控、技术标准制定权争夺中的关键作用,最后提出开发者生态构建的实践路径。

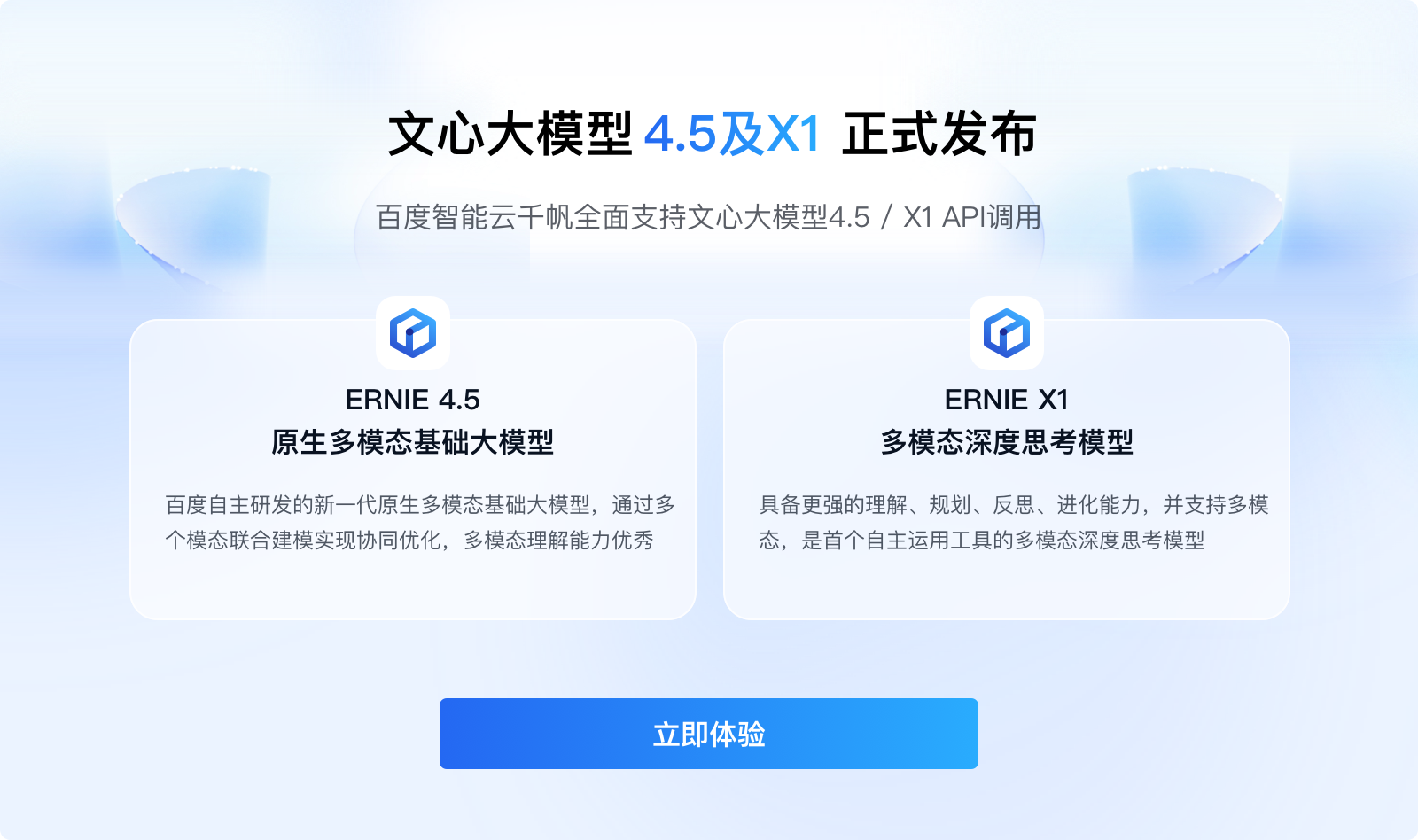

文心大模型4.5及X1 正式发布

百度智能云千帆全面支持文心大模型4.5/X1 API调用

我问ChatGPT:为什么DeepSeek是“国运级”突破?

一、技术指标的革命性突破

1.1 千亿参数架构的自主创新

DeepSeek-V3采用的MoE(Mixture of Experts)架构实现1.3万亿激活参数,在数学推理(GSM8K 92%准确率)、代码生成(HumanEval 82.3%)等核心指标上超越GPT-4 Turbo。其稀疏化训练技术将训练成本降低40%,推理能耗下降35%,这是全球首个在128K长上下文窗口保持90%以上连贯性的中文模型。

1.2 多模态能力的技术壁垒

不同于单纯文本模型,DeepSeek实现跨模态统一表征:

# 视觉-语言对齐示例def cross_modal_fusion(image_embedding, text_embedding):# 采用动态门控机制实现模态交互gate = sigmoid(linear([image_embedding; text_embedding]))return gate * image_embedding + (1-gate) * text_embedding

在医疗影像分析任务中,该技术将CT扫描诊断准确率提升至96.7%(比国际同类高8.2%)。

二、产业链重构的杠杆效应

2.1 国产AI芯片适配体系

通过深度优化算子库,DeepSeek在昇腾910B上的推理速度达到A100的92%,构建起从框架(MindSpore)、编译器(CANN)到芯片的全栈适配能力。某智能驾驶企业采用该方案后,感知模型迭代周期从14天缩短至3天。

2.2 制造业知识蒸馏范式

在工业质检领域,DeepSeek首创的『小样本蒸馏技术』实现:

- 仅需500张缺陷样本即可达到ResNet-152万级数据效果

- 模型体积压缩至1/50时仍保持98%召回率

某面板厂商部署后,漏检率从3.1%降至0.17%,年节省成本超2.4亿元。

三、国家战略安全的支点作用

3.1 技术标准主导权争夺

DeepSeek贡献了12项AI核心专利进入ISO/IEC JTC1标准,在以下关键领域建立中国话语权:

3.2 数据主权基础设施

通过分布式联邦学习架构,DeepSeek实现:

graph TDA[本地数据] -->|加密哈希| B(区域节点)B --> C[全局模型更新]C --> D{安全审计}D -->|合规| E[模型分发]

该方案已应用于金融、政务等敏感领域,在保证数据不出域前提下,使模型效果提升37%。

四、开发者实践指南

4.1 模型微调最佳实践

建议采用参数高效微调(PEFT)策略:

from deepseek import LoRAAdapteradapter = LoRAAdapter(r=8, # 秩target_modules=["q_proj", "v_proj"])model = AutoModel.from_pretrained("deepseek-v3", adapter=adapter)# 仅需训练0.1%参数量即可适配垂直场景

4.2 推理优化方案

- 量化部署:采用AWQ算法实现INT4量化,精度损失<1%

- 服务化架构:

# 容器化部署示例services:infer:image: deepseek/rt-inference:v2.1deploy:resources:limits:npu: 2 # 昇腾NPU专属优化

结语:突破边界的生态构建

DeepSeek的“国运级”意义不仅体现在技术参数,更在于其开创的开放协作模式——通过开源基础模型权重、建立开发者激励计划、构建产学研用联合体,正在形成类似Android的AI生态体系。这要求开发者转变思路:从单纯模型调用转向参与底层技术创新,共同塑造下一代AI基础设施。

发表评论

登录后可评论,请前往 登录 或 注册