深度解析:Llama2模型的优势与潜力

2023.10.08 02:37浏览量:3简介:Llama/Llama2论文解读

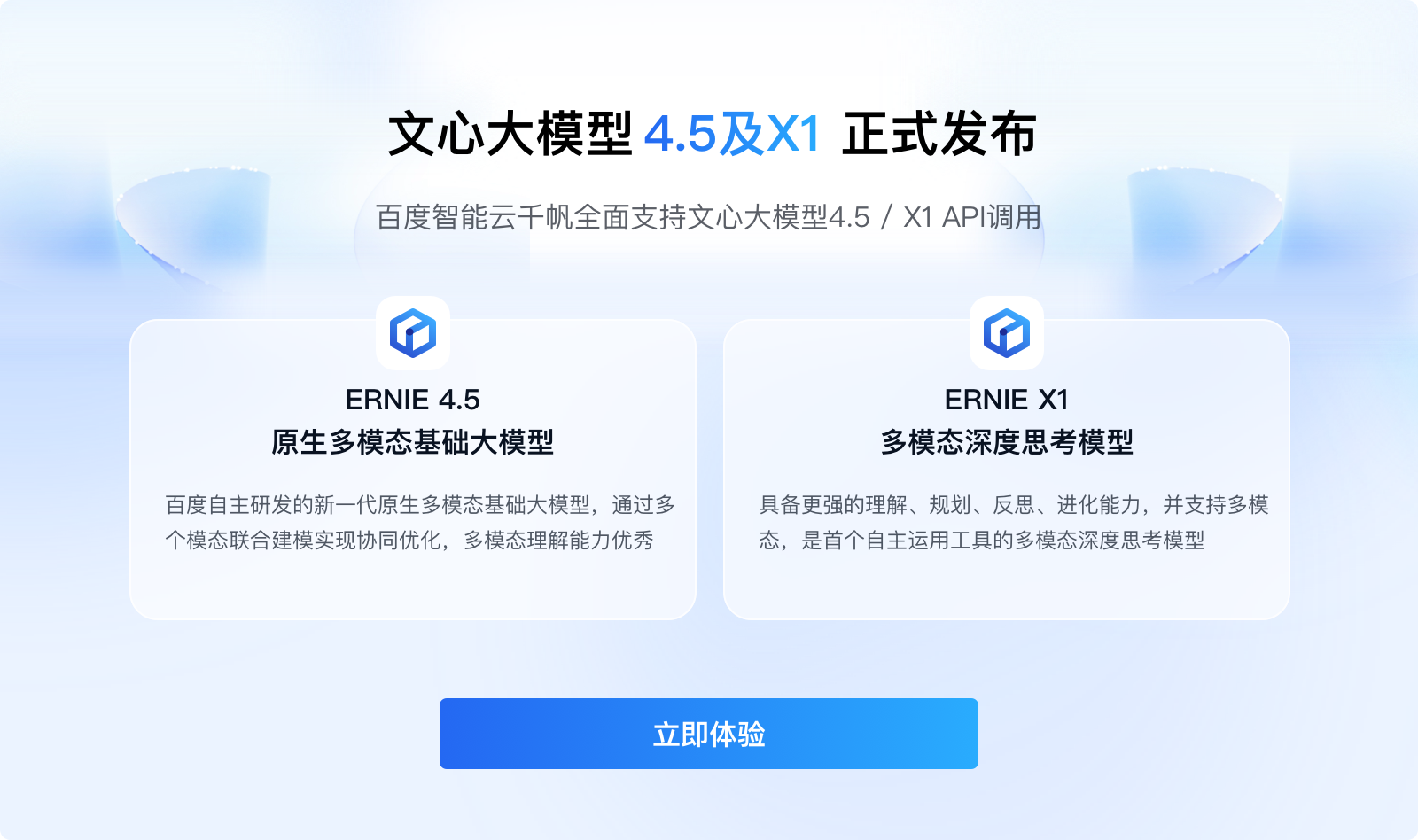

千帆应用开发平台“智能体Pro”全新上线 限时免费体验

面向慢思考场景,支持低代码配置的方式创建“智能体Pro”应用

Llama/Llama2论文解读

Llama和llama2是近年来在自然语言处理(NLP)领域备受关注的研究方向。在这篇论文中,我们将深入探讨llama和llama2的背景、重点词汇或短语、理论分析、研究方法以及结论与展望。

背景介绍

随着人工智能技术的不断发展,自然语言处理技术也得到了广泛的应用。在众多NLP研究方向中,llama和llama2以其独特的优势引起了研究者的浓厚兴趣。llama(Labeled Layers Assisted by Gammas)和llama2(Labeled Layers Assisted by Gammas 2)是两种基于深度学习的自然语言处理模型,主要应用于文本分类、情感分析、语言生成等任务。

重点词汇或短语

在这篇论文中,我们将重点解读以下词汇或短语:

- 神经网络:神经网络是llama和llama2模型的核心组成部分,它通过模拟人脑神经元之间的连接方式来进行信息处理。

- 层次结构:llama和llama2采用层次结构的设计方法,将文本信息处理分为多个层次,每个层次处理不同的任务,最终将各层次的输出进行整合得到最终结果。

- 标签层:标签层是llama和llama2模型的一大特点,它在模型训练过程中为输入文本提供标签,帮助模型学习文本特征。

- gamma参数:gamma参数在llama和llama2模型中起到调节标签层和神经网络之间信息传递的作用,有助于提高模型的训练效果。

理论分析

基于对llama/llama2的背景介绍和重点词汇或短语的解析,我们可以进一步分析并阐释相关理论。首先,llama和llama2模型采用深度学习框架,通过神经网络实现文本信息的特征提取和处理。其次,层次结构的设计使得模型能够逐层处理不同的文本特征,并将各层次的输出进行有机整合。此外,标签层在模型训练过程中提供了有监督的学习方式,帮助模型更好地学习文本特征。最后,gamma参数的引入调节了标签层与神经网络之间的信息传递,提高了模型的训练效果和泛化能力。

研究方法

在研究llama和llama2的过程中,我们采用了以下研究方法:首先,通过文献调研了解llama和llama2的背景及研究现状;其次,基于公开数据集进行实验设计,包括数据收集、预处理和模型训练等环节;最后,运用定量分析和定性分析相结合的方法对模型进行评估,并对实验结果进行分析与讨论。

结论与展望

通过深入解读llama/llama2论文,我们可以总结出以下结论:首先,llama和llama2模型作为基于深度学习的自然语言处理模型,具有独特优势;其次,标签层、层次结构以及gamma参数等设计使得模型在文本分类、情感分析等任务上具有较好的性能表现;最后,虽然llama和llama2模型在某些任务上已经取得了不错的成果,但仍然存在一些不足之处,例如模型的泛化能力还有待进一步提高。

展望未来,我们建议可以从以下方向进行深入研究:首先,进一步优化模型结构,提高模型的性能表现;其次,探讨如何有效利用无标签数据来提高模型的训练效果;最后,将llama和llama2模型应用于更多的自然语言处理任务,为实际应用场景提供更多支持。总之,llama和llama2论文为我们提供了宝贵的学术资料,通过深入解读和理解这些论文的内容,我们可以不断推动自然语言处理技术的进步与发展。

发表评论

登录后可评论,请前往 登录 或 注册